28 ország és a legnagyobb techcégek vezetői csúcstalálkozót tartottak, ahol azt ígérték, közösen mérik fel a mesterséges intelligencia jelentette kockázatokat. A világhírű történész szerint ez jó, de közel sem elég.

2023 novembere mérföldkő lehet a mesterséges intelligencia történetében, ugyanis a hónap elején a legnagyobb, MI-vel kapcsolatos diplomáciai eseményre került sor.

Az Egyesült Királyságban 28 ország, köztük az Egyesült Államok, európai uniós tagországok és Kína képviselői gyűltek össze, hogy megvitassák, milyen veszélyeket jelenthet az emberiségre nézve a mesterséges intelligencia. A konferencián a vezető technológiai és mesterséges intelligencia vállalatok, például az Anthropic, a Google DeepMind, az IBM, a Meta, a Microsoft, az Nvidia, az OpenAI és a Tencent vezetői is részt vettek. Ott volt Elon Musk és António Guterres, az ENSZ főtitkára is.

A találkozót III. Károly király nyitotta meg, aki videobeszédeben kijelentette, „az emberi törekvések történetében az egyik legnagyobb technológiai ugrásnak lehetünk tanúi.”

A csúcstalálkozót a történelmi jelenőségű Blechley Parkban tartották. A második világháború idején ezen a helyen működött az Egyesült Királyság fő kódfejtő intézménye. A helyszínnel Alan Turing brit matematikus előtt tisztelegtek, aki itt segített a náci Enigma kód feltörésében, 1950-ben pedig ő volt az, aki egy máig ható tudományos dolgozatban vizsgálta: „Tudnak-e gondolkodni a gépek?”

A kérdés több mint 70 évvel később aktuálisabb, mint valaha. Világosan látszik, hogy a mesterséges intelligencia-rendszerek felgyorsíthatják a betegségek diagnosztizálását, segíthetnek a klímaváltozás elleni küzdelemben és a gyártási folyamatok ésszerűsítésében, de jelentős veszélyeket is hordoznak. Tavaly a nagy nyelvi modellek meglepő, és néha már kissé ijesztő képességeket mutattak.

Az Egyesült Államok alelnöke, Kamala Harris szerint az MI jelentette kockázatoknál elég csak a deepfake képekre és videókra gondolnunk. Amikor egy nyugdíjasnak megszűnik az egészségbiztosítása egy hibás MI-algoritmus miatt, vagy egy nőt deepfake fotókkal zsarol a volt partnere, az egzisztenciális fenyegetést jelent – példálózott Harris.

A brit kormány friss jelentése pedig arra figyelmeztet, hogy a fejlett mesterséges intelligencia-rendszerek

A mesterséges intelligencia ráadásul már most bizonyítottan képes olyan dolgokra, amikről sok szakértő korábban úgy vélte, hogy csak évek múlva lehetségesek. Néhány kutató ennek alapján úgy gondolja, hogy az olyan rendszerek, amelyek képesek lemásolni az általános emberi intelligenciát, sokkal közelebb lehetnek, mint gondolnánk.

A Blechley Parkban tartott csúcstalálkozó végén kiadott nyilatkozatban a résztvevők deklarálták, hogy

„Az MI-ből eredő számos kockázat eredendően nemzetközi jellegű, ezért a legjobban nemzetközi együttműködésen keresztül lehet őket kezelni. Elhatározzuk, hogy együttműködünk az emberközpontú, megbízható és felelősségteljes mesterséges intelligencia biztosítása érdekében” - áll a dokumentumban.

Rishi Sunak, az Egyesült Királyság miniszterelnöke mérföldkőnek nevezte a nyilatkozatot. Mint mondta: a világ legnagyobb MI hatalmai egyetértettek abban, hogy sürgősen szükség van a mesterséges intelligencia kockázatainak megértésére „a gyerekeink és unokáink jövője érdekében.”

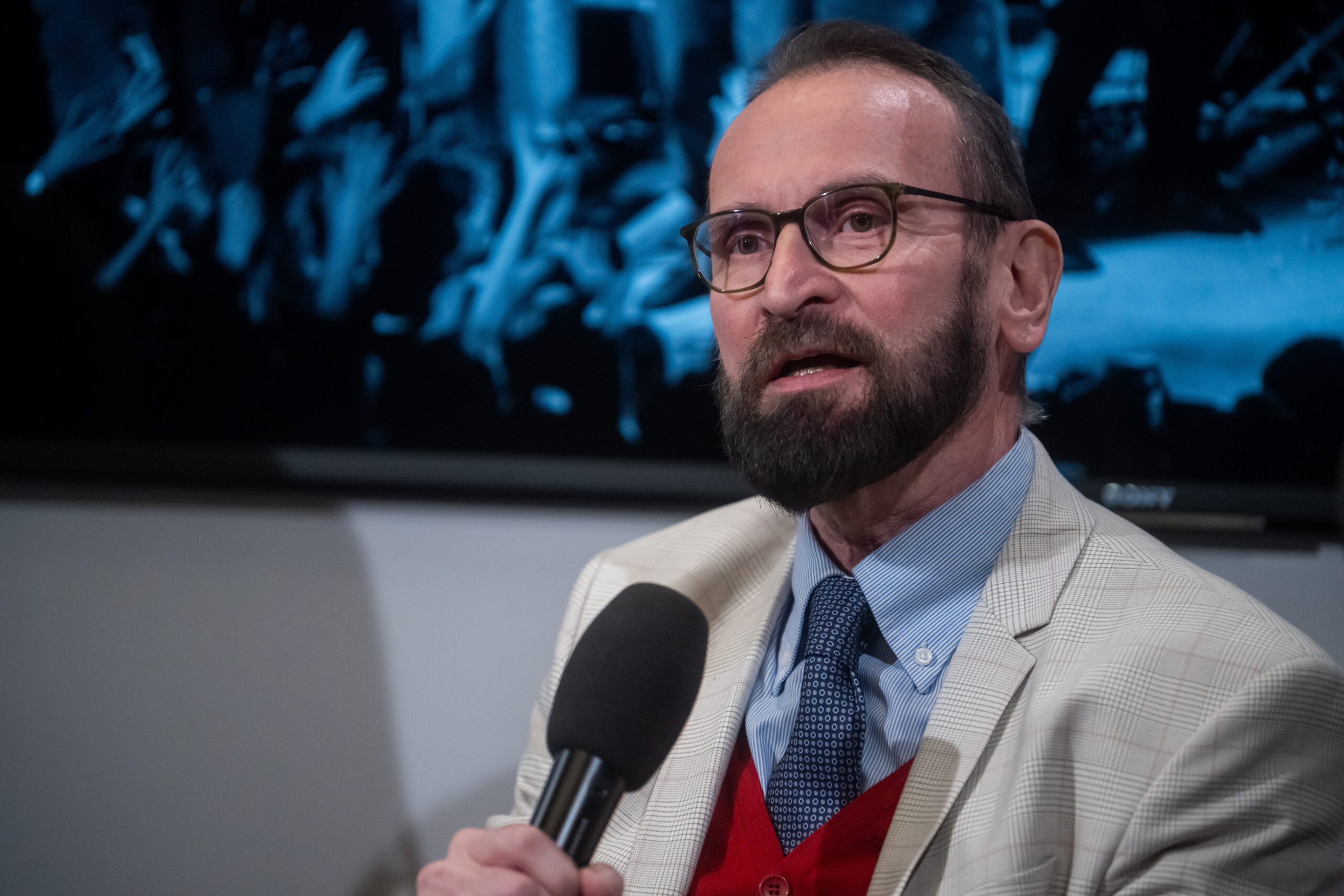

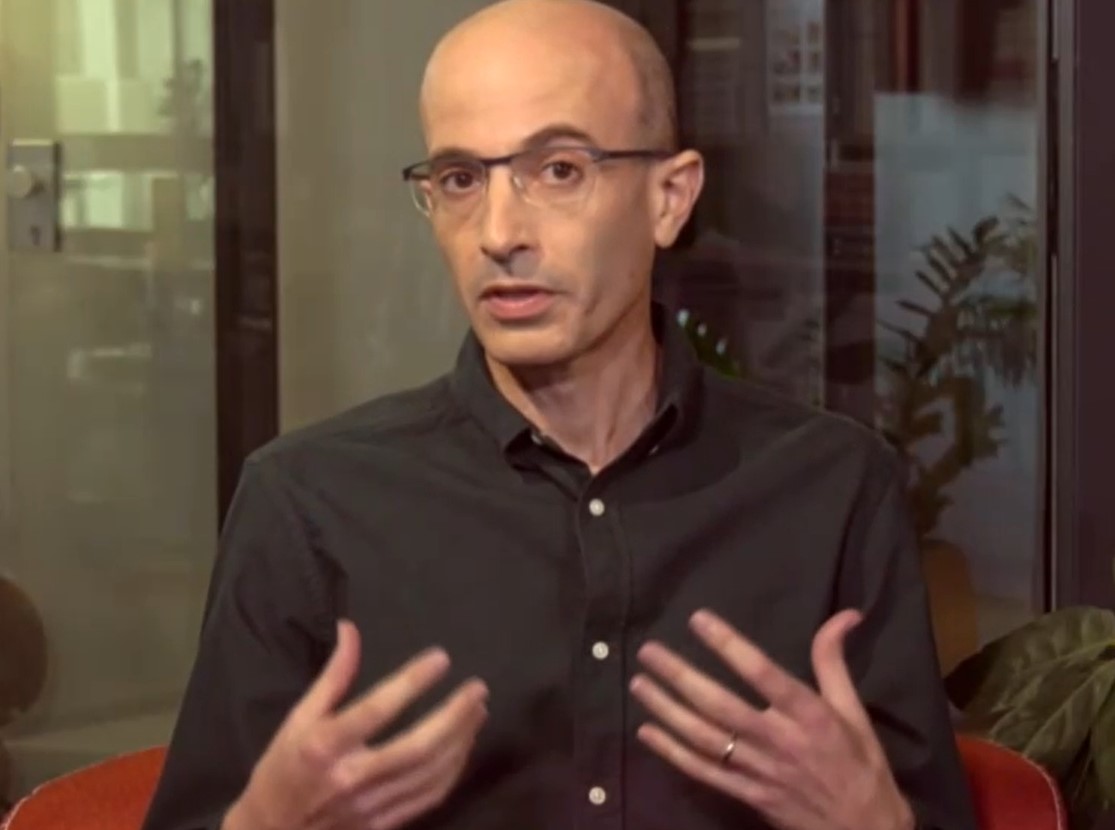

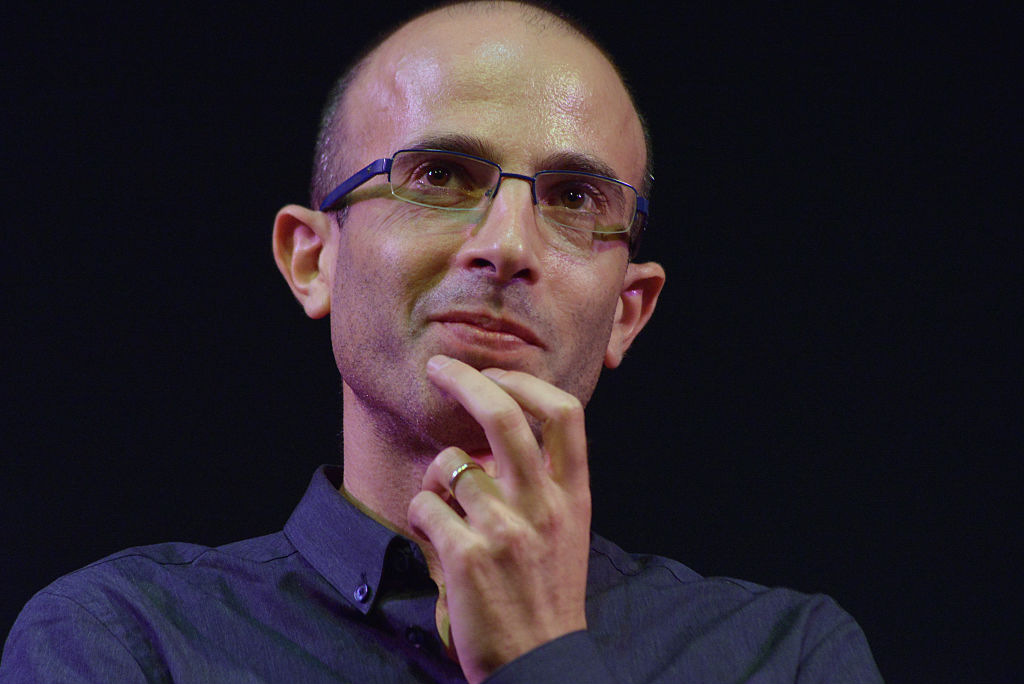

Yuval Noah Harari világhírű izraeli történész, a mesterséges intelligencia veszélyeivel is foglalkozó Sapiens könyvek szerzője a Guardiannak szintén azt mondta, a kiadott nyilatkozat „nagyon fontos előrelépés”, mivel a világ legerősebb nemzeteinek kormányai közösen fejezték ki aggodalmukat a technológiával kapcsolatban.

„Talán a legreménytelibb az, hogy nemcsak az Európai Unió, az Egyesült Királyság és az Egyesült Államok, hanem Kína kormánya is aláírta a nyilatkozatot. Szerintem ez nagyon pozitív jel. Globális együttműködés nélkül rendkívül nehéz, ha nem lehetetlen lenne kivédeni a mesterséges intelligencia jelentette veszélyeket” - mondta Harari.

A Nagy-Britanniában elfogadott közös nyilatkozat azonban nem határozott meg konkrét politikai célokat - hívja fel rá a figyelmet a New York Times. Csak abban állapodtak meg, hogy hat hónap múlva újra találkoznak Dél-Koreában, egy év múlva pedig Franciaországban.

„A mesterséges intelligencia különbözik az emberiség történetének minden korábbi technológiájától, mert ez az első olyan technológia, amely képes önállóan döntéseket hozni, új ötleteket hozhat létre, magától tanulhat és fejlődhet. Szinte definíció szerint rendkívül nehéz az embereknek, még a technológiát létrehozó embereknek is előre látni az összes lehetséges veszélyt.”

Harari szerint erre jó példa, hogy a kormányok most például azzal érveltek, hogy a mesterséges intelligencia segíthet új biológiai fegyvereket létrehozni. De arról senki sem beszél, mekkora kockázatokat jelenthetnek a pénzügyi világban.

„Ez az ideális terület a mesterséges intelligencia számára, mert csak adatokról van szó” – érvel Harari.

„Mi történik, ha a mesterséges intelligencia új pénzügyi eszközöket kezd létrehozni, amelyeket egyetlen ember sem érthet meg?” Harari felhívja a figyelmet, hogy a 2007–2008-as pénzügyi válságot olyan adósságinstrumentumok okozták, mint például az értékpapírosított jelzálogfedezetű kötvények (CDO), amiket kevesen értettek meg, és ezért nem szabályozták őket megfelelően.

„A mesterséges intelligencia képes olyan pénzügyi eszközök létrehozására, amelyek nagyságrendekkel összetettebbek, mint a CDO-k. És képzeljük csak el azt a helyzetet, amikor olyan pénzügyi rendszerünk van, amelyet egyetlen ember sem képes megérteni, és ezért nem is képes szabályozni” – mondta.

Az izraeli szerző szerint nem a konkrét szabályozásokra és törvényekre kell összpontosítani, hanem azokra a szabályozó intézményekre, amelyek ismerik a mesterséges intelligencia fejlesztését.

„Erőteljes szabályozó intézményeket kell létrehoznunk, amelyek képesek felismerni a felmerülő veszélyeket és reagálni rájuk annak tudatában, hogy nem tudjuk előre megjósolni az összes veszélyt és problémát, és nem tudunk előre jogszabályt alkotni ellenük. Ez legyen a fő irány, nem pedig egy nagyon hosszú és bonyolult szabályozás megírása, amely a parlamenten vagy a kongresszuson áthaladva elavulttá válhat” - mondta a Guardiannak.

Biden elnök aláírt egy végrehajtási rendeletet is. Ez előírja, hogy a legfejlettebb mesterséges intelligencia eszközöket alkalmazó vállalatok teszteljék rendszereiket, hogy megbizonyosodjanak arról, hogy nem használhatóak biológiai vagy nukleáris fegyverek előállítására. A vállalatoknak jelenteniük kell a tesztek eredményeit a szövetségi kormánynak – bár az eredményeket nem kell nyilvánosságra hozni.

A rendelet felvenné a harcot a deepfake-kel is, a manipulált képek és videók ugyanis befolyásolhatják a választási eredményeket vagy becsaphatják a fogyasztókat. Javasolják a mesterséges intelligencia eszközökkel készített fényképek, videók és hangok vízjelezését, mert ez a módszer segíthet felderíteni az online tartalom eredetét.

Az amerikai elnök szerint már három másodpercnyi hangminta is elég, hogy manipulált hanganyag készüljön az MI segítségével. „Megnéztem egy ilyet” – mondta Biden. Egy olyan elnöki nyilatkozatot hoztak létre a munkatársai, ami soha nem hangzott el, és ami alkalmas lett volna egy politikai vagy nemzetbiztonsági válság kirobbantására.

Joe Biden emellett megerősítette azt az új szabályozást, amely megakadályozza, hogy Peking hozzáférjen a nagy nyelvi modellek előállításához szükséges legerősebb számítógépes chipekhez, valamint ahhoz az információtömeghez, amellyel a mesterséges intelligencia rendszereket képzik.

Jonas Tallberg professzor, aki a stockholmi egyetemen a mesterséges intelligencia szabályozásának geopolitikai következményeit vizsgálja, a Wired című magazinnak úgy fogalmazott: hatalmas a tét. Aki győztesként kerül ki az MI fegyverkezési versenyből, annak várhatóan jelentős befolyása lesz országok és térségek gazdasági versenyképességére és geopolitikai pozíciójára.