Techguru szakértők több lehetséges forgatókönyvet is felvázoltak arra, hogy az MI miként hozhat teljes pusztulást a Földre. Jó lenne ezeket elkerülni.

A mesterséges intelligencia (MI) általi kihalás kockázatát egyenrangúként kell kezelni a világjárványok és az atomháború veszélyével – figyelmeztet közleményében a Centre for AI Safety (Mesterséges Intelligencia Biztonsági Központ) elnevezésű nonprofit szervezet.

A mesterséges intelligencia elszabadulásának veszélyeire rámutató nyílt levelet már több százan aláírták, köztük globális techvállalatok vezetői, kutatók, biztonságpolitikai szakértők, így például a Google Deepmind és a ChatGPT-t fejlesztő OpenAI szakemberei.

A Center for AI Safety az alábbi veszélyeket, katasztrófa-forgatókönyveket vázolja fel a mesterséges intelligenciával kapcsolatban.

Társadalmi szempontból súlyos probléma lehet, hogy az MI által generált félretájékoztatás destabilizálhatja a társadalmakat és „alááshatja a kollektív döntéshozatalt”, miközben a mesterséges intelligencia könnyen lehetővé teheti a rezsimek számára az átfogó megfigyelést és az elnyomó cenzúrát.

Élettani következményként pedig valós veszély, hogy az MI-től függő emberek fizikailag jelentősen legyengülhetnek, aminek számos egészségügyi kockázata van.

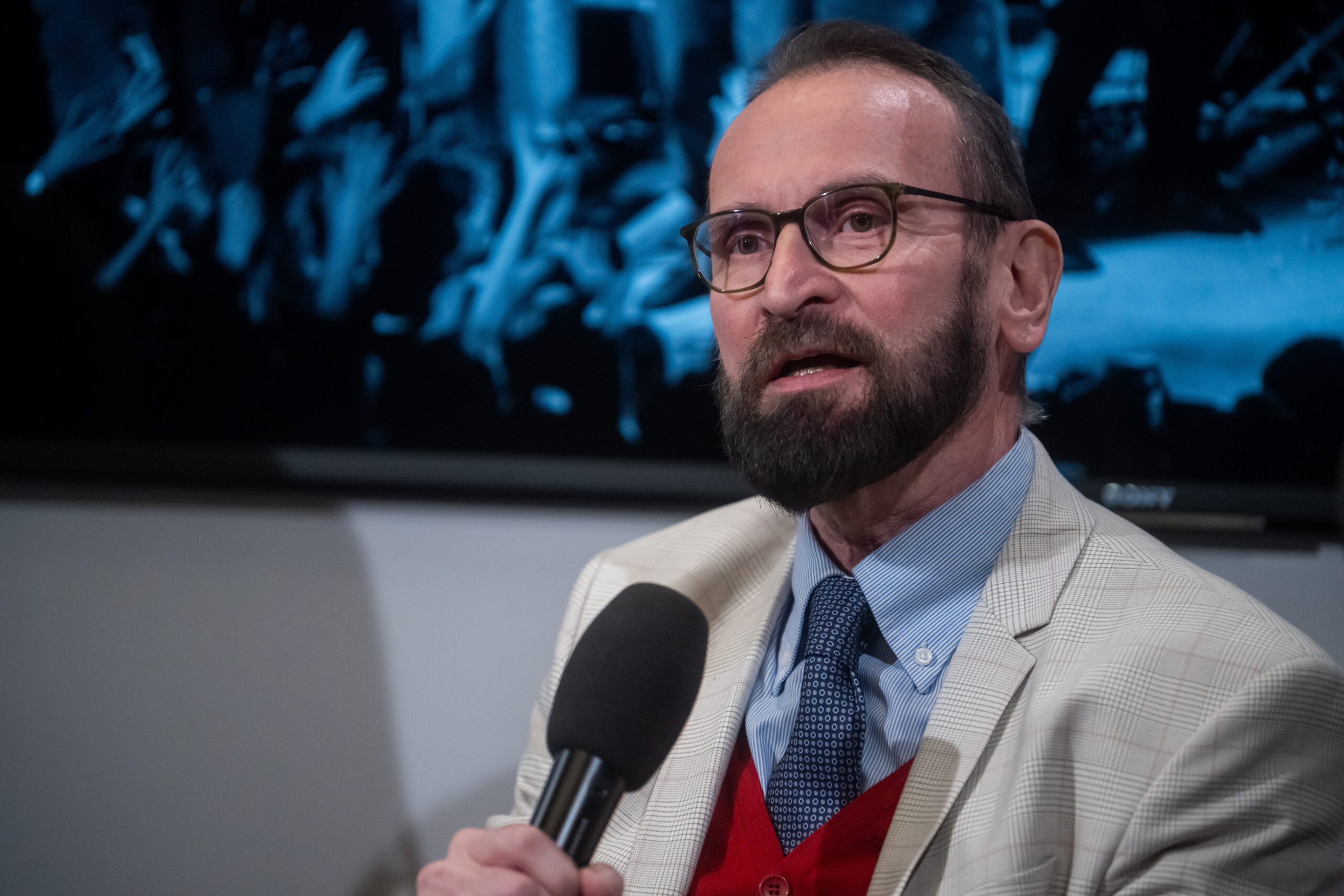

Dan Hendrycks, a Center for AI Safety ügyvezető igazgatója szerint a mesterséges intelligencia számos „fontos és sürgető kockázatot” rejt magában, mint például a rendszerszintű torzítás, a félretájékoztatás, a rosszindulatú felhasználás, a kibertámadás és a fegyverkezés.

Hozzátette: elképzelhető, hogy az elkövetkező tíz évben az MI-rendszerek meghaladják az emberi szakértői képességek szintjét, és a szuperintelligencia erősebb lesz, mint más technológiák, melyeket az emberiségnek a múltban ki kellett ismernie.

A mesterséges intelligencia általi kihalás kockázatát egyenrangúként kell kezelni a világjárványok és az atomháború veszélyével – írja közleményében a Centre for AI Safety.

Forrás: Unilad