A mesterséges intelligencia (MI) fénysebességszerű fejlődésének köszönhetően számos olyan automatikus rendszer kiépítése válik lehetővé, melyek jelentősen megkönnyíthetik az életünket. Az orvosok MI-t használó rendszerek segítségével találhatnak meg rákos sejteket, a járművezetést mesterséges intelligencia venné át, és az adminisztrációs folyamatokat is megkönnyítené a technológia.

E hatalmas potenciálból fakadóan több európai állam is alkalmaz már mesterséges intelligenciát valamilyen területen. A holland rendőrség például MI-t használ arra, hogy gyanúsítottak fényképeit gyorsabban hasonlítsa össze a bűnözési adatbázissal. A londoni rendőrség pedig valós idejű arcfelismerő rendszert használ gyanúsítottak azonosítására.

Az éremnek azonban két oldala van. Míg az MI gyógyírt nyújthat a társadalom számos bajára, bőven akadnak veszélyei is.

Így például az MI a valós idejű tömeges megfigyelés alapjait fektetné le, ami veszélyezteti az anonimitást és sértheti az európai polgárok alapvető jogait.

Digitális azonosításkor például az MI gyakrabban ejt hibát a női arcok felismerésében, mint a férfiakéban, a hibás azonosítás pedig téves letartóztatásokhoz és diszkriminációhoz vezethet.

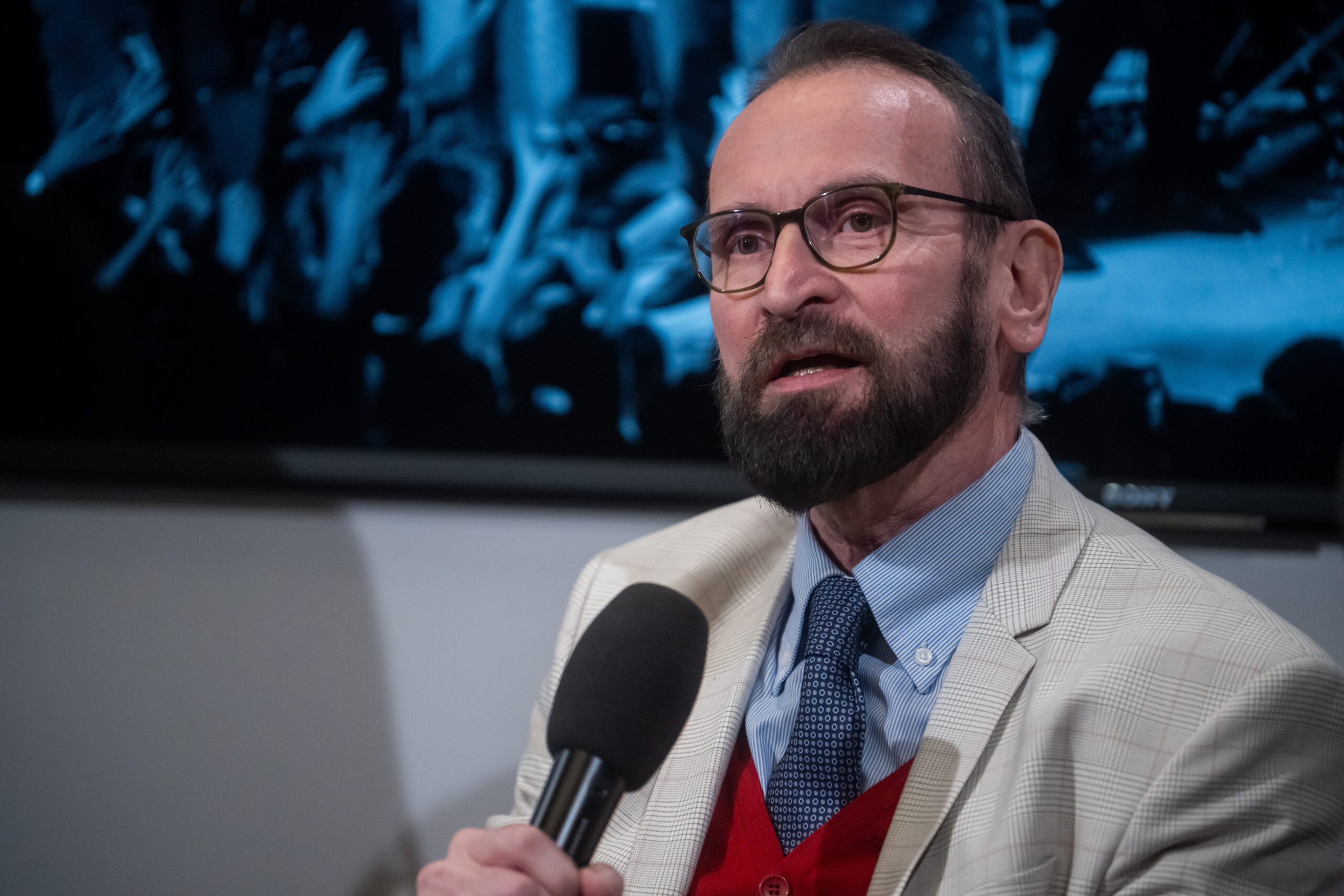

Úgy tűnik tehát, hogy az MI alkalmazása során egyensúlyt kell találni a progresszív lehetőségek és az esetleges káros következmények között. Ezen dolgoztak az Európai Parlament képviselői, amikor egy MI-ről szóló jelentlést vitattak meg október 4-én Strasbourgban. A Petar Vitanov (S&D) által készített dokumentum egy évekig tartó konzultációs folyamat kritikus állomása, amelynek során az Európai Unió egy világszinten is párját ritkító jogi keretrendszert alakítana ki a mesterséges intelligencia használatának szabályozására.

A sztori idén áprilisban kezdődött, amikor az Európai Bizottság előterjesztette a mesterséges intelligencia használatáról szóló jogszabályjavaslatát. A dokumentum több kategóriába sorolja a mesterséges intelligenciára alapuló rendszereket:

- tiltott MI-gyakorlatok, amelyeket nem engedélyezne a jogszabály. Ilyen például az MI használata arra, hogy egyes személyek társadalmi megbízhatóságát pontozzák.

- Nagy kockázatú rendszerek: olyanok, melyek nagy befolyással vannak az emberek egészségére, biztonságára vagy alapvető jogaira. Ilyen lehet például az MI alkalmazása orvosi eszközökben. Tekintettel e rendszerek érzékeny mivoltára, a gyártónak magas elvárásoknak kell megfelelniük a fejlesztés közben, mint például a szoftver részletes és érthető dokumentációja, valamint a mesterséges intelligencia emberi felügyelete.

- Ezen kívül vannak még a korlátozott kockázatú (chatbot használata információkeresésre), illetve alacsony kockázatú rendszerek (levélszemetet szűrő alkalmazások). E két kategória szabályozása kevésbé ellentmondásos, mint a nagyobb kockázatúaké.

A bizottság két tűz közé szorult: egyrészt az Amerikai Egyesült Államok (ahol decentralizált, lazább módon szabályozzák az MI-t) figyelmeztette az EU-t, hogy az MI-szektor túlszabályozása gátolhatja az innovációt. Ugyanakkor a civil szervezetek és a parlamenti képviselők szerint a szabályozás nem elég szigorú és részletes.

Kulcsfontosságú területeket nem tekint "nagy kockázatúnak" a beterjesztett javaslat, így például a közösségi médiát és az online vásárlást.

Továbbá a nagy kockázatú rendszerek esetében a gyártónak kellene megállapítania, hogy a saját terméke összhangban van-e a jogszabályban foglalt paraméterekkel. Külső felülvizsgálat hiányában azonban az önvizsgálat objektivitása megkérdőjelezhető.

Azt is kritizálják, hogy bizonyos rendelkezések kiskaput nyújthatnak az MI használóinak. A javaslat például tiltaná a "valós idejű" biometrikus azonosítást közterületen bűnüldözési okokból (ebben a kontextusban a biometrikus azt jelenti, hogy a kinézet, hang, arc és járás alapján azonosítanának valakit). Ez szigorú rendelkezésnek látszik, csakhogy a biometrikus azonosítás egyáltalán nem kizárt más esetekben, így például felvételről.

Kifogásolták még az MI egyik kulcsfontosságú elemét, a gép tanulási folyamatát. A mesterséges intelligencia ugyanis nem a semmiből terem, a gépet tanítani kell. A bírálat tárgya az, hogy a tanulási folyamat következtében a gép korántsem objektív és semleges, mint ahogy azt sokan hiszik. Amennyiben a gép fejlesztői elfogultak, az MI is az lesz.

A történet következő epizódja júniusban az Európai Adatvédelmi Testület (a tagállamok adatvédelmi hatóságaiból álló testület) és az Európai Adatvédelmi Felügyelő (az uniós intézményeket felügyelő szerv) nyilatkozata volt, miszerint a bizottság jogszabályjavaslatának további területeket kellene még szabályoznia. Az adatvédelmi szervek szerint az MI veszélyezteti az EU-s polgárok alapvető jogait, ezért a lehető legszélesebb körű tilalmakat kell alkalmazni. Javaslatuk szerint tiltani kellene mindenfajta automatizált azonosítást közterületeken, nem csak a "valós idejűeket".

Sőt, kiterjesztenék a tilalmat olyan MI-rendszerekre, amelyek biometrikus adatokat használnak arra, hogy kategorizálják az embereket etnikum, politikai orientáltság vagy szexuális beállítottság alapján.

A folyamat legutóbbi állomása a fentebb említett parlamenti vita és az utána elfogadott állásfoglalás volt. Az adatvédelmi szervekhez és civil szervezetekhez hasonlóan az Európai Parlament is szigorítaná a szabályokat. Szélesítené például a tiltott alkalmazások körét: az állásfoglalás szerint a hatóságoknak nem szabadna olyan, magánjellegű arcfelismerő adatbázisokat használni, mint az amerikai Clearview AI.

Vitanov szerint az MI hibái a sebezhető társadalmi csoportokat érintik a leginkább, például a bevándorlókat és a szegényeket. Karen Melchior dán képviselő (Renew) szerint pedig az MI-kockázatelemzés és az automatizált döntéshozó rendszerek olyan veszélyt jelentenek a demokráciára, mint az atombombák az élővilágra.

Az Európai Bizottságot Ylva Johansson belügyi biztos képviselte. A biztos emlékeztetett az MI egyik közelmúltbéli sikerére, amikor is a holland bűnügyi újságírót, Peter R. de Vries-t megtámadó gyanúsítottakat rekordgyorsasággal kapta el a rendőrség az MI segítségével. A biztos szerint több indoka is van annak, hogy a mesterséges intelligenciát szélesebb körben alkalmazzák a hatóságok. Bizonyos esetekben például a rendőröknek több ezer terrabájtnyi adatot kellene átvizsgálniuk, amit egy gép sokkal gyorsabban el tudna végezni. Ráadásul ma már a bűnözők is használnak MI-t, főként csalásoknál. E bűnözők elkapásához a hatóságoknak a legmodernebb eszközökre van szükségük.

A pozitív fejlemények és sikertörténetek ellenére az Európai Parlament nyilvánvalóvá tette, hogy a technológiát szkepticizmus övezi: a szigorítást javasló jelentést 377 képviselő támogatta, 248 ellenezte, 62-en tartózkodtak. A bizottság nem köteles megfogadni a jelentésben foglalt útmutatást, de a parlament üzenete világos: a mesterséges intelligenciát szoros kereteken belül kell tartani.

A projekt az Európai Unió társfinanszírozásával, az Európai Parlament kommunikáció területére vonatkozó támogatási programja keretében valósult meg. Előkészítésében az Európai Parlament nem vett részt, és semmilyen felelősséget vagy kötelezettséget nem vállal a projekt keretében nyilvánosságra hozott információkért és álláspontokért, amelyekért kizárólag a szerzők, a megkérdezett személyek, a program szerkesztői és terjesztői felelősek az alkalmazandó jognak megfelelően. Az Európai Parlament nem felel a projekt megvalósításából esetlegesen származó közvetlen vagy közvetett károkért sem.

Iratkozz fel hírlevelünkre!

Ne maradj le! Az Európai Unió legfontosabb politikai eseményeiről hetente értesülhetsz hírlevelünkből.

Iratkozz fel hírlevelünkre!

Kedves Olvasónk!

Már csak egy kattintásra van szükség, hogy megerősítsd feliratkozási szándékodat! Amennyiben nem kapod meg megerősítő e-mailünket, kérünk, ellenőrizd a levélszemét mappádat.